3.9分钟训完GPT-3,英伟达H100再次刷新MLPerf六项纪录,创造新纪元!

更新时间:2023-11-09 14:40:40作者:kzmyhome

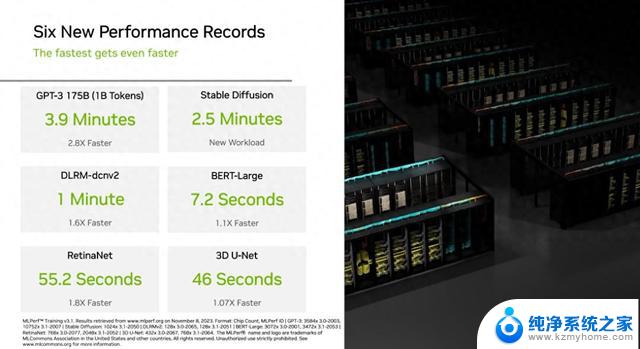

11 月 9 日消息,英伟达今天发布新闻稿。表示旗下的 H100 GPU 在 MLPerf 基准测试中创造了 6 项新记录。

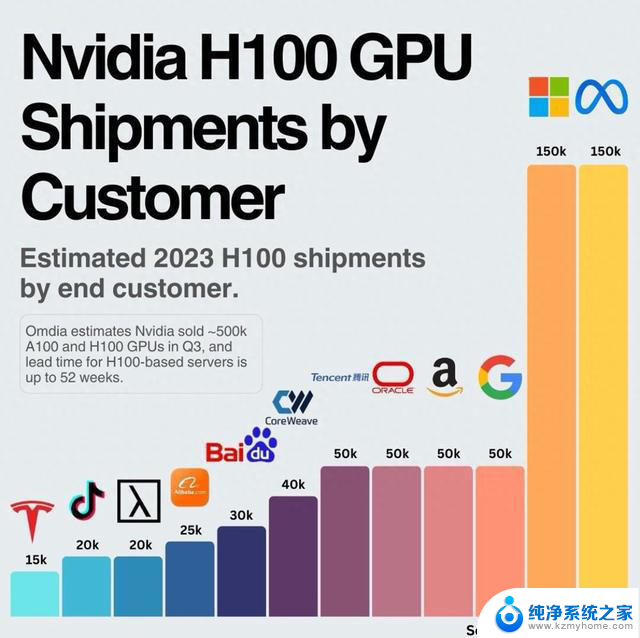

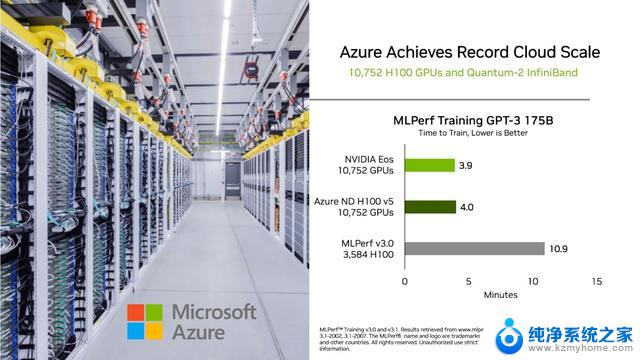

今年 6 月报道,3584 个 H100 GPU 群在短短 11 分钟内完成了基于 GPT-3 的大规模基准测试。

MLPerf LLM 基准测试是基于 OpenAI 的 GPT-3 模型进行的,包含 1750 亿个参数。

Lambda Labs 估计,训练这样一个大模型需要大约 3.14E23 FLOPS 的计算量。

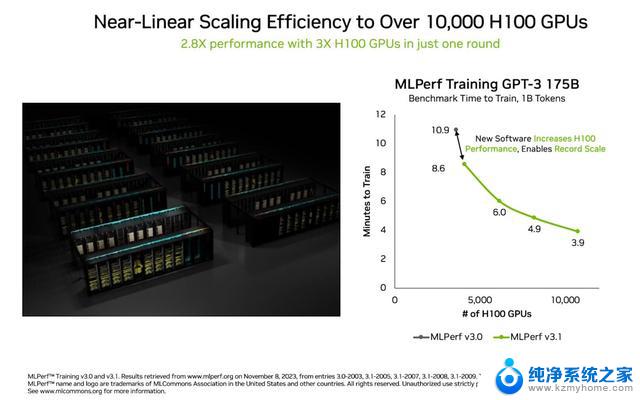

英伟达最新的 Eos AI 超级计算机配备了 10752 个 H100 Tensor Core GPU 和 NVIDIA 的 Quantum-2 InfiniBand 网络,训练完 GPT-3 仅仅只需要 3.9 分钟,比 6 月的测试结果整整快了 7 分钟。

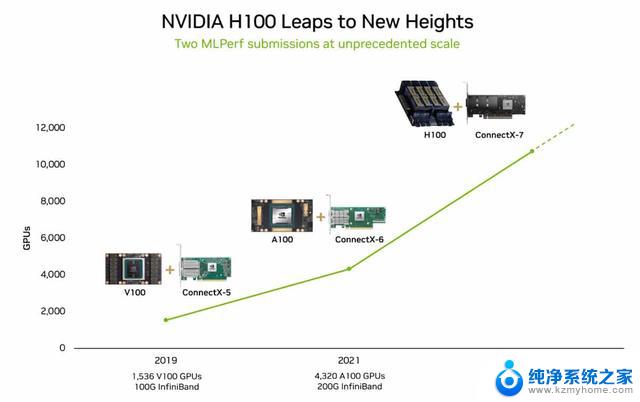

英伟达在帖中,的另一项创纪录的成就是在“系统扩展”方面取得的进步,通过各种软件优化,效率提高到了 93%。

高效扩展在行业中非常重要,因为实现高计算能力需要使用更多的硬件资源。如果没有足够的软件支持,系统的效率会受到大幅影响。