Nvidia B100/B200/GB200 关键技术解读:性能提升与创新应用

更新时间:2024-03-26 19:27:24作者:kzmyhome

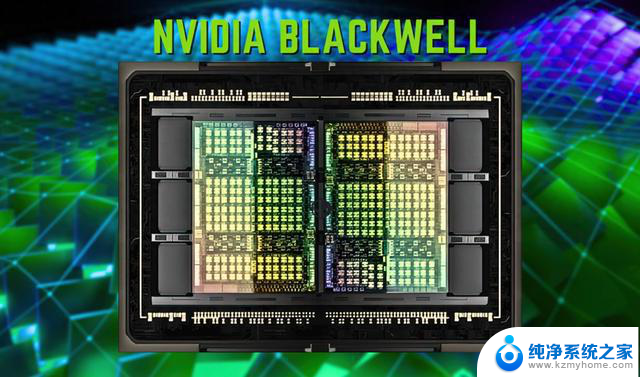

芯片

芯片1. GPU芯片

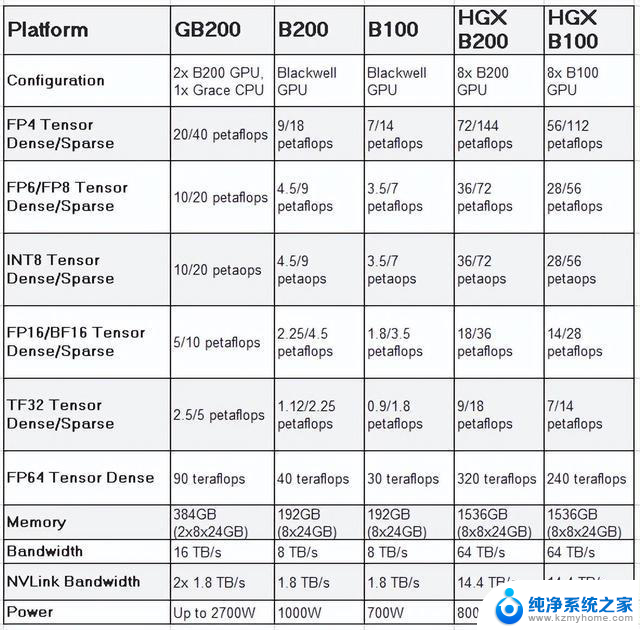

晶体管数:B200 GPU的晶体管数量是现有H100的两倍多,但B200封装了2080亿个晶体管(而H100/H200上为800亿个)。这意味着B200芯片封装密度比H100进一步提高,对管理散热和功耗也提出了更高的要求。FP4精度:引入一种新的计算精度,位宽比FP8进一步降低,B200峰值算力达18P。FP6精度:位宽介于FP4和FP8之间。NV高带宽接口(Nvidia High Bandwidth Interface):B200有两个Die,高速连接通道NV-HBI达到10TB/s。两个Die是一个统一的Cuda GPU。NV-HBI会占用一定的芯片面积。内存:B200每个Die有4个24GB的HBM3e stack,合计一个Cuda GPU有192GB内存,内存带宽达8TB/s。相比H200时代六个内存控制器,可以减少内存接口的芯片面积,从而使得计算面积可以更大。GB200:有两个B200(4个GPU Die)和一个Grace CPU,2700W。2. NVLink芯片

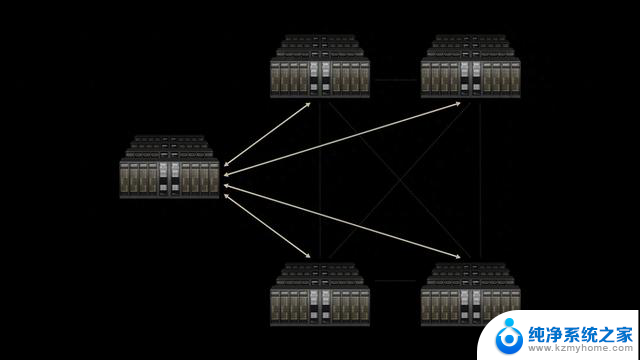

第五代NV-Link芯片,双向带宽达1.8TB/s = 18(links) * 50GB/s (bandwidth each direction) * 2,是Hopper GPU使用的第四代NV-Link的2倍。最大支持576个GPU的连接,相比上一代是256个。

3. NVSwitch芯片

第四代NVSwitch芯片,7.2TB/s的全双工带宽,是上一代的两倍。

4. DPU和CPU没有更新

服务器HGX B200:一机八B200整机解决方案。每个B200是1000W。HGX B100:一机八B100整机解决方案。每个B100是700W。GB200 SuperPOD 服务器

GB200 superchip:2个CPU和4个B200。这个compute tray是1U的,液冷。GB200 NVL72:包含18个1U compute tray(共72个B200)、9个Switch Tray(共18个Switch )。GB200 superPOD:576个B200 GPU。与H100相比,superpod的训练性能提升4倍,推理性能提高30倍,能效提高25倍。